今年も開催されます!

ありがたいことに今年もお手伝いしています。

今回担当しているのはレーザーに加え、新たに追加されたドローンにつけるLEDの制作です。

詳細はこちらをごらんください。

http://blog.hi-farm.net/2017/03/07/yoritomo2017/

今年も開催されます!

ありがたいことに今年もお手伝いしています。

今回担当しているのはレーザーに加え、新たに追加されたドローンにつけるLEDの制作です。

詳細はこちらをごらんください。

http://blog.hi-farm.net/2017/03/07/yoritomo2017/

BeyondはPangolin社が発売しているレーザー操作用のソフトウェアです。

Quickshowと違い、本格的な使用に向いています。

ビームを制作するためのツールがより種類が多く、Quickshowではタイムラインが1種類しかなかったりコピペなどしにくかったのですがこちらではより簡単に操作できるので制作時間を短縮、

またメッシュワープなどのマッピング時に使える機能やMTCなどの同期システムなど外部との連携機能も充実しています。

さらに上位バージョンになると3Dの対応も行われ、素早くクオリティの高いショーを制作することが可能です。

ただ、プロフェッショナル向けのツールということもあり、値段がQuickshowと比べると高くなっています。

具体的な値段はPangolinのwebsiteかContactよりお問い合わせください。

Beyond製品ページ:

http://pangolin.com/product-category/software-license/

QuickShowとは、Pangolin社から発売されているレーザーを操作するためのアプリケーションです。

これを使うと非常に簡単にレーザーを操作することができる入門編としては適しているソフトではないかと思います。

制御には主にILDAを使います。

また、このソフトだけでは制御できず、ILDAケーブルとPCから出ているUSBケーブルの間にFB3というデバイスが必須です。

こちらはビギナー向けという性質からか、細かいところの機能が足りていません。

既存のレーザーを出すだけであれば問題ないですが独自でビームを作る場合や時間軸にあわせてレーザーのタイミングを制御する場合にコピペや複数の移動などの細かい機能が足りなくて無駄に多くの作業時間を使うことになります。

もし本格的にやるなら上位ソフトのBeyondを買ったほうが良いかもしれません。

Quickshow製品ページ:

http://pangolin.com/shop/fb3qs-quickshow-hs/

今年も東京駅八重洲口、「東京駅グランルーフ Light on Train」が開催されている麓の木のイルミネーション映像を作りました。

今年はWOWさんがインスタレーションを作ったそうで。

うらやましいものです。

こちらはというと全体のテーマと馴染むように作っていて、今年は青〜白の範囲で光らせています。

なかなかバリエーションを持たせるのが難しかったですが、先日点灯チェックしながら来年こういうのしたいね、という話もあがったりなので来年もあればそのバリエーションも作ろうと思います。

あるいは他の箇所でできれば。

ちなみに、2015年版はこちらです。

http://hi-farm.net/detail/2015/12/01/tokyo-yaesu-illumination-tree/

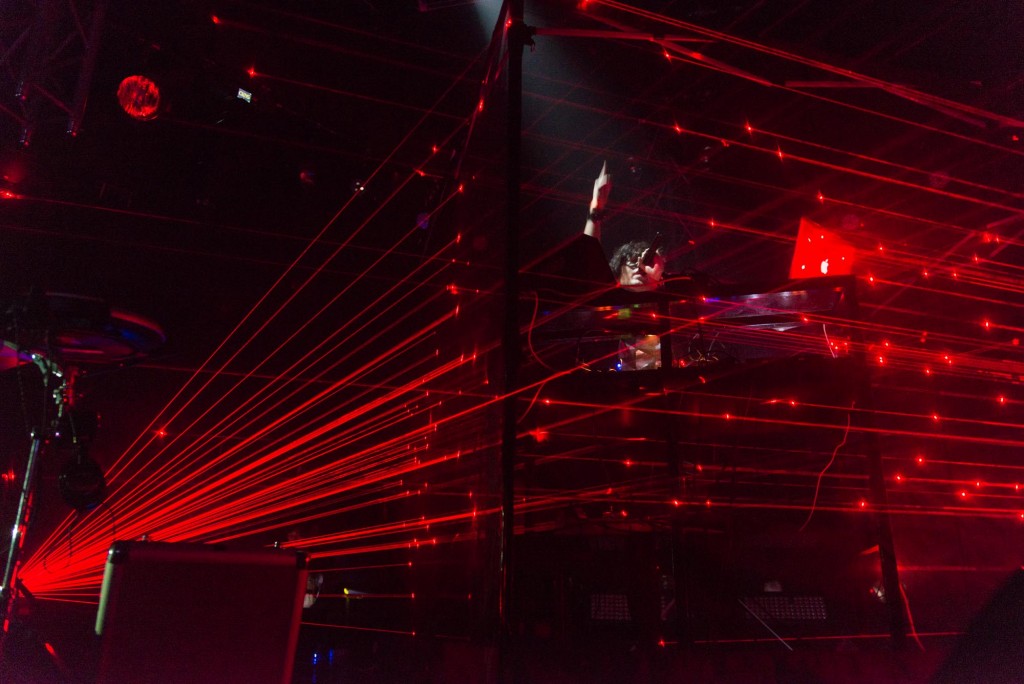

いつもレーザーをやらせてもらっているRAM RIDERがなんと4年ぶりにワンマンライブをする。

いろいろ試行錯誤はしていたけど定着せず、初めてレーザーをやったのがこの4年前のワンマンライブ。

その4年分の、ってわけじゃあないのですがせっかくなのでと自分にとって新しいことをさせてもらいました。これまでイベントで設営中だったりライブだったりできれいだなーって思ったけどどこで使えるんだろう?と思ってたことなどを仕込むことができました。

写真をみてもらうのが分かりやすいですが、ステージ上のスクリーンにレーザーをあててこんな感じの映像を作成・投影していました。

結果的にはスモークが入ったことで自分が想像してたよりも光の空間を作っている感じになったのはうれしいことでした。

ここで写真を1枚。

なるべく映像っぽく音と同期させるように作ってみました。

機材側もLED衣装で何度も(他の仕事でも)助けてもらっているゆきちゃんと詰めていてざくざくと物事が進んで行ったり、音のタイミング合わせや機材のことなど4年で得た経験を活かすことができたし、VJのセーラーチェンソー村上さんともご一緒することが増えたから?か今まで以上に連動してる感じがあったのではないでしょうか。他にもいろいろありますがひとまずはよかった。滝さんの映像もさすがよかった。

なんか主役じゃない僕が書きすぎると出しゃばってる感じがするのでこの辺にしておきます。

一旦できたことでほっとしているところもあるのですが、まだまだやり残していることがあるのでまた何かしらでこういったことができるといいなあ、と思いつつ準備しておこうっと。

今後オフィシャルの写真とか映像とか上がってくるといいなあ。上がってきたらこちらにもアップするなりリンクを貼るなりしようと思います。

なんかハッシュタグ #rr161120 にライブ関連のツイートがいっぱい上がっているようです。

写真や動画も投稿されているようですのでよろしければそちらをみていただけると様子が分かるのではないでしょうか。

※写真は撮影でされてた木村さんのを使わせていただいております。やはりちゃんとしたカメラマンさんが撮るととんでもなく素敵だ。

※もちろん安全性を考慮した上で演出を行っております。

追記:動画を追加しました。

RAM RIDER – LIVE20161120 laserbox from Mitsuru Takeuchi on Vimeo.

写真は舞台の模様をぼんやりみせつつ、実際に使った外付けグラボです。

数年前のNADAにはじまり、

今年2月に湯河原で開催された頼朝の洞でもお手伝いしております

インテグラル・ビジョン・グラフィックスさまのお仕事で今回もお手伝いしました。

内容は2016年10月7日に東京・日本橋福徳の森特設ステージにて開催された「幕開き日本橋-東京2020文化オリンピアードキックオフ-」のイベント。ここで能と映像、音楽とのコラボレーションにてセンシング部分を担当しました。

※53分頃から始まっている演目です。

「演者の動きに合わせて映像をインタラクティブに動かす」というものでうまく行き過ぎると作り込み映像と変わらないし、合わなさすぎると気持ち悪いという難しさもありますがなにより今回は

・リハーサルの回数が少ない

・衣装が和服?だろうから骨格認識はできない

・屋外なので外部環境に左右されることが多い

というのが一番難しいところでした。

さらにはイベントの進行があるのでセンシングができなからといって流れを止めることができないというこれまた密かなプレッシャーがありました。

(こういうのは何度やって慣れていても終わるまでは安心できないものでして・・・性格かな)

センシングに関するところはリアルタイムですが様子を見ながらビジュアル要素をその場で変えるところもあり、

VJ的にミックスとの連携も必要だったのですが漠然とすり合わせだけしてあとは様子を見ながらお互いに変えていくというのは作り込みが多い僕にとってはライブ感があってなかなか面白かったです。

わかりにくいかもしれませんがその時の様子はここからどうぞ。

ちなみにその個所はiPadから要素を変更できるように作っておいて離れたところから舞台を見ながら変えていました。

ああいった場でできるのはなかなか貴重だったのではないかと思います。

これからもいろいろと面白い場所で面白いことができるといいなあ、と思っています。

参考:

狂言の宴とプロジェクションマッピングとの融合:(レーザー、センシング)

NADA Project Vol2:センシング

NADA Project Vol2 – Kagura – Full version from Takayuki Baba on Vimeo.

ちょくちょくお誘いいただくBENZENE by VMTTさんからお誘いいただいてサマソニのSonic Stageのヘッドホンデコレーションのシステムを制作しました。

フロアに設置された4つのヘッドフォンからLEDの映像と照明、音が出るようになっていて、簡易サラウンドのようなものになっています。

映像をもとにバーチャル空間上に音源を配置し、バーチャル空間上にあるオブジェクトから音を出し、対応する箇所が光るように信号を送りました。

インタラクティブ系の機能も作っていたし、今回の経験でまたやりたいことも出てきたので今後もこういう機会があるととても嬉しいです。

期間限定ですが、fabcafeさんのTRY!SurfaceBookキャンペーンでインタビューが掲載されております。

慣れないのでなかなか緊張するものですね。

久しぶりに活動+初の遠征でたのしかったです。

京都world初めて入りましたがすごい素敵な場所でした。